一文解锁AI Agent全栈架构:工程化落地的秘密武器

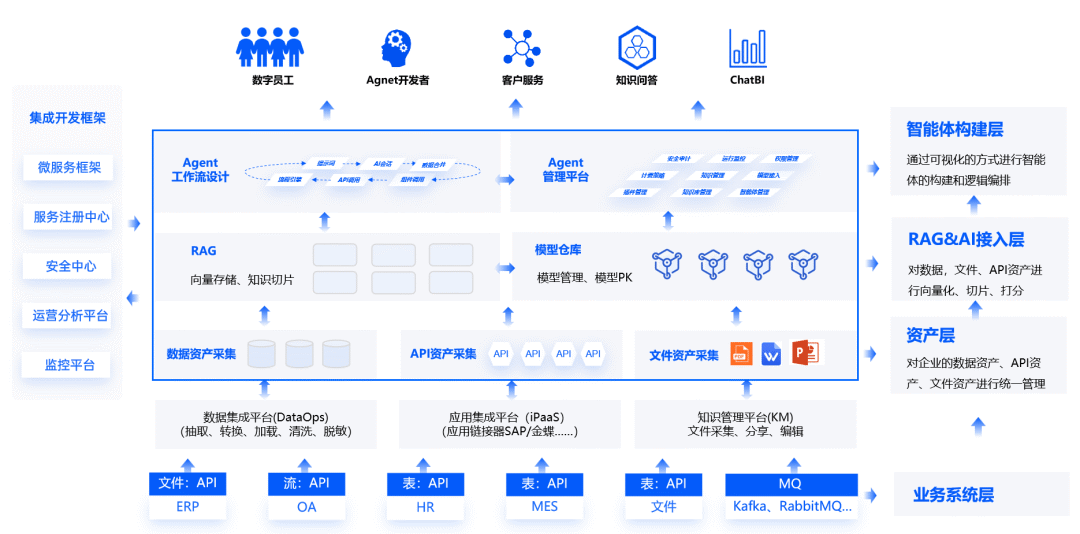

摘要:本文系统介绍了AIAgent全栈架构的六大核心模块,为企业智能化转型提供工程化解决方案。首先是运行环境,通过Docker实现稳定部署;其次是MCP服务,将模型能力转化为可执行动作;LangChain和LangGraph构成智能体的逻辑引擎;监控体系保障行为可控;AI原生IDE提升开发效率;多模型基座实现智能路由。文章还提供了从0到1的实战指南,强调AIAgent已从实验室走向商业应用,未来竞

在AI大模型席卷全球的当下,AI Agent(智能体)早已不是实验室里的“玩具”,而是企业智能化转型的核心引擎。但如何从“能跑通的Demo”升级为“稳定可演化的系统”?本文将通过一套完整的AI Agent全栈架构图,带你拆解六大核心模块,手把手教你打造工程化、可维护的智能体系统。

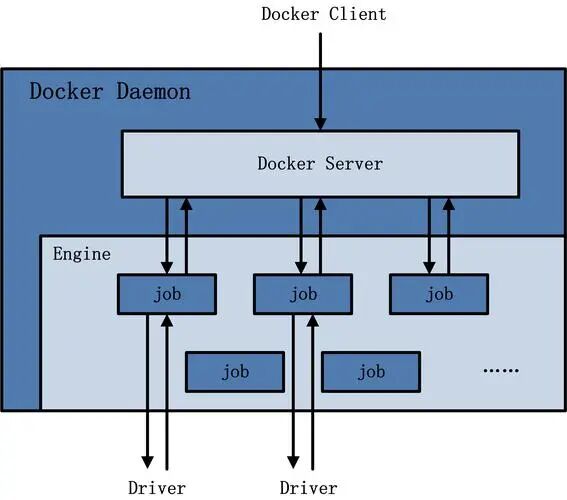

一、运行环境:智能体的“稳定基石”

Q:为什么运行环境是AI Agent的第一道关卡?

A:没有稳定的“家”,再强的智能体也寸步难行。

AI Agent的运行环境决定了系统的稳定性、扩展性和跨平台能力。一个成熟的架构通常包含两部分:

-

Docker环境:统一部署与隔离保障

通过容器化技术(如MongoDB存储非结构化数据、MySQL存储结构化数据、Nginx管理流量),实现本地、测试、生产环境的一致性,支持快速部署和独立扩展。

-

本地环境:灵活调试与快速验证

开发者使用Windows/MacOS + Chrome + Terminal组合,在本地快速验证功能后一键迁移至容器环境,极大提升迭代效率。

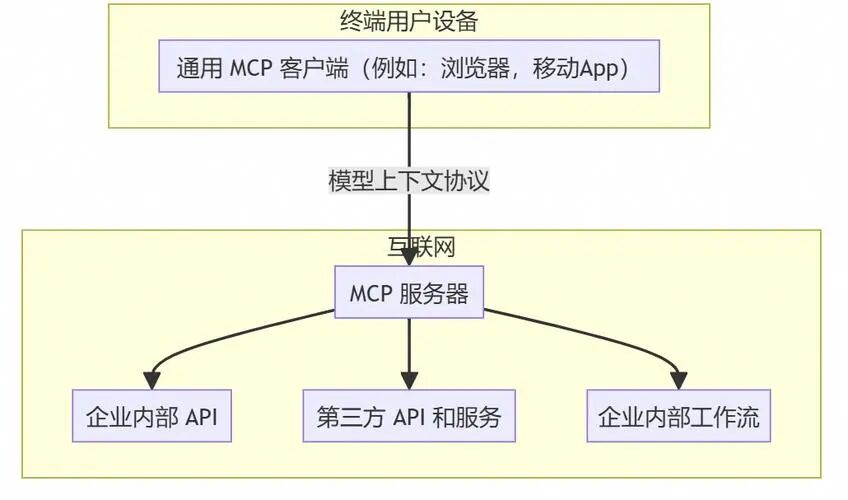

二、MCP服务:智能体的“工具腰带”

Q:MCP如何让AI Agent从“纸上谈兵”变为“实战高手”?

A:它把模型能力转化为可执行的动作。

MCP(Model Context Protocol)是AI编程工具集的核心,扮演着“肌肉和手脚”的角色:

- 数据交互

:通过MongoDB/MySQL实现结构化与非结构化数据的存储与检索。

- 任务执行

:FAAS(函数即服务)按需调用计算资源,Nginx/Docker支撑服务通信。

- 系统能力

:Terminal/Browser/Files操作系统的文件与网页,RAG模块提供“检索增强生成”能力。

落地要点:

✅ 接口模块化:每个能力(如文件读写、数据库查询)独立为API。

✅ 统一协议:通过JSON Schema定义输入输出格式,确保调用安全。

✅ 安全审计:所有调用经Nginx网关记录日志,便于监控与回溯。

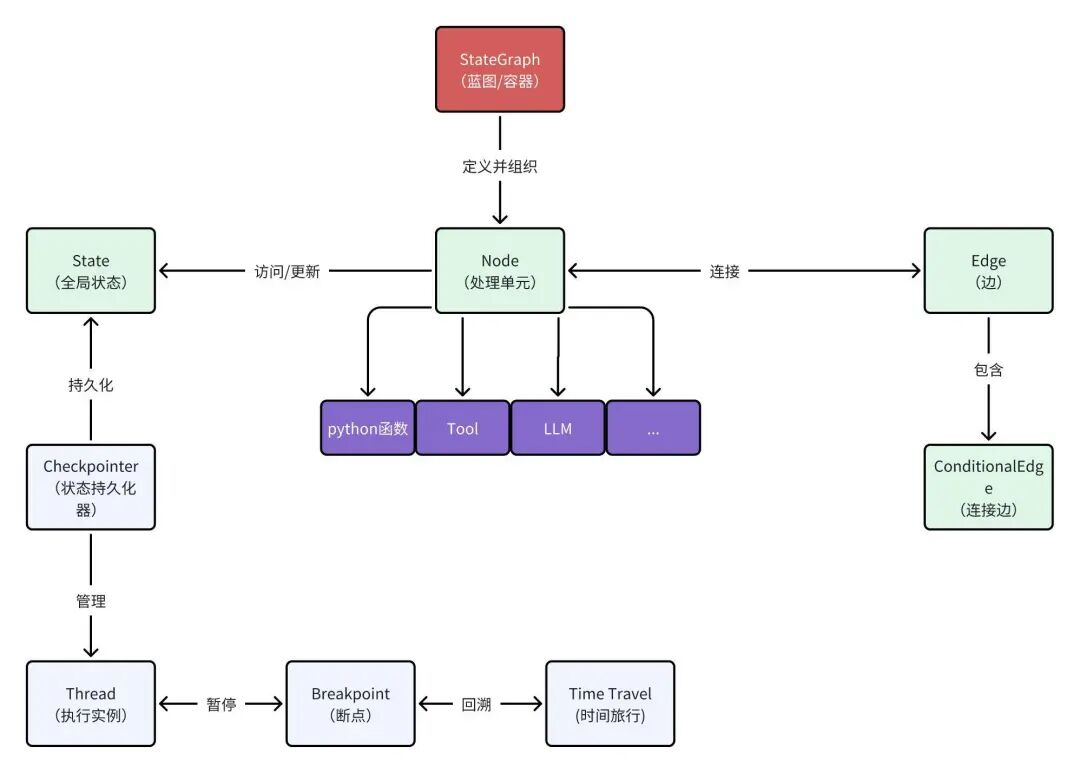

三、LangChain + LangGraph:智能体的“逻辑双引擎”

Q:如何让AI Agent的决策流程清晰可控?

A:LangChain搭骨架,LangGraph画地图。

- LangChain:定义智能体的逻辑骨架

将复杂AI逻辑分解为模块:

- Agents

:决策与任务分配

- Tools

:对接MCP服务的具体工具

- Memory

:存储上下文与长期记忆

- Prompts

:统一管理提示词模板

- Agents

- LangGraph:流程编排与可视化

像画工作流一样设计Agent的调用逻辑,支持多工具调用、并行任务编排和失败重试机制。

实战建议:

-

封装常用Tool(如搜索、数据查询)为模块,集中管理。

-

使用JSON Schema校验LLM输出,避免“提示词漂移”。

-

建立Prompt仓库,统一版本管理。

四、监控体系:智能体的“黑匣子”与“体检报告”

Q:如何确保AI Agent的行为始终正确?

A:用LangSmith追踪对话,用Langfuse监控质量。

-

LangSmith:对话级追踪与链路回放

记录每次对话的Prompt调用、Tool执行和模型返回结果,方便复盘优化。 -

Langfuse:质量与性能监控

监控请求延迟、Token消耗、RAG命中率等指标,自动告警低置信度输出。

落地建议:

-

引入Trace ID实现全链路追踪。

-

对重要操作(如系统指令)添加二次确认。

-

监控指标覆盖“模型表现”与“系统健康”。

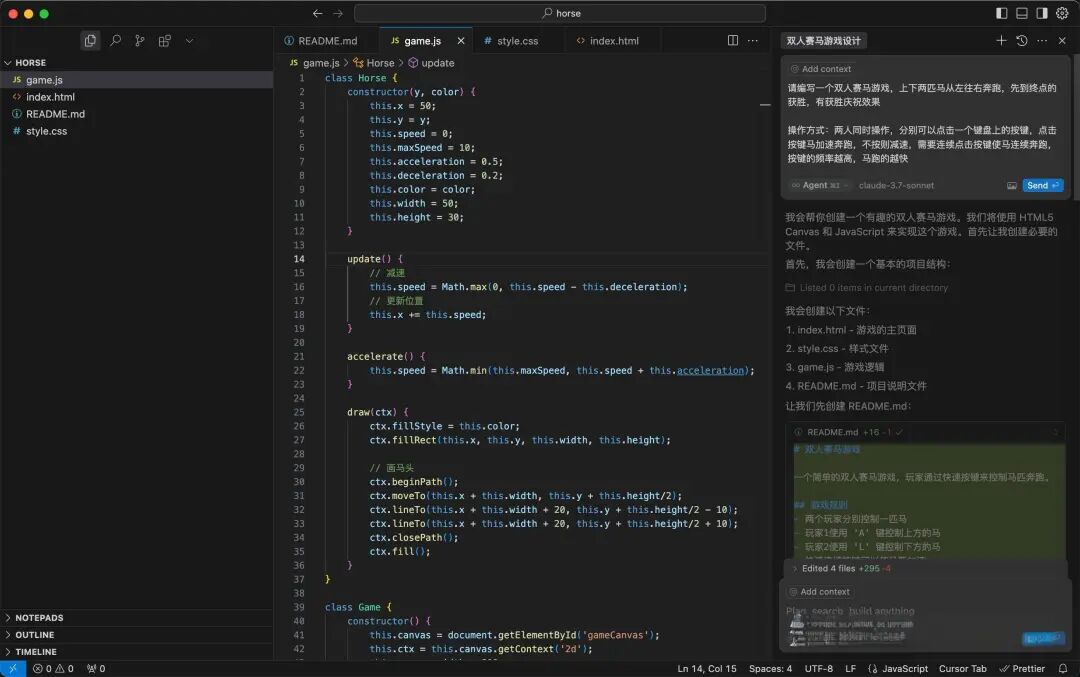

五、AI IDE:开发者的“超级工作台”

Q:传统IDE能满足AI开发需求吗?

A:当然不行!AI原生IDE才是未来。

以Cursor为代表的AI原生IDE,集成了Prompt调试、工具链测试、生成式代码辅助和实时模型反馈功能,让开发者在一个界面中完成从Prompt迭代到Agent行为验证的全流程。

应用建议:

-

打通Cursor与LangSmith日志系统,实现“本地调试—线上复盘”闭环。

-

利用Prompt版本控制功能,记录不同版本下的模型表现。

六、大模型基座:多模型协同的“智能路由”

Q:单一模型能满足所有需求吗?

A:多模型协同才是王道!

架构底层支持多模型并存:

- 通义千问3

:中文语义与任务理解强

- Claude 4

:逻辑推理与英文任务优

- DeepSeek R1

:推理优化与成本低

核心策略:

-

事实型问题→通义千问+RAG

-

逻辑型任务→Claude

-

大批量计算→DeepSeek

-

高价值场景→双模型比对取优

七、工程落地全清单:从0到1的实战指南

- 启动阶段

:搭建Docker环境,实现最小可用Agent(LangChain + Tool + 模型)。

- 扩展阶段

:接入MCP服务(RAG/Browser/FAAS),加入监控与日志。

- 优化阶段

:用LangGraph编排复杂流程,建立Prompt与Schema版本库。

- 稳定阶段

:模型多路由,成本与性能监控,自动评测与A/B测试。

结语:AI Agent的未来,属于体系化竞争

AI Agent已不再是“玩具项目”,而是企业智能化的关键入口。真正的挑战不在模型,而在体系。通过运行环境、工具集、框架、监控、IDE和模型基座的“六层闭环”,智能体才能具备持续学习、可控演化的能力。

未来已来,只是尚未均匀分布。 打造你的AI Agent生态系统,抢占智能化转型的制高点!

火山引擎开发者社区是火山引擎打造的AI技术生态平台,聚焦Agent与大模型开发,提供豆包系列模型(图像/视频/视觉)、智能分析与会话工具,并配套评测集、动手实验室及行业案例库。社区通过技术沙龙、挑战赛等活动促进开发者成长,新用户可领50万Tokens权益,助力构建智能应用。

更多推荐

已为社区贡献5条内容

已为社区贡献5条内容

所有评论(0)